Instrument

Ziehe eine Linie von links nach rechts im unten eingeblendeten Feld. Eine KI spielt daraufhin einen Synthesizer, der der Linienführung folgt, die du gezeichnet hast. Experimentiere mit geraden Linien, diagonalen Linien oder Wellenlinien. Du kannst neben durchgehenden Strichen auch kurz unterbrochene Linien zeichnen.

Ist das ein Musikinstrument? Musikinstrumente setzen ausdrucksstarke Bewegungen von Spieler*innen in musikalische Klänge um. Bei traditionellen Instrumenten formt eine bestimmte Bewegung den Klang, sie muss aber auch die „akustische Energie“ liefern: zum Beispiel das Zupfen einer Saite, das Blasen einer Flöte oder das Schlagen einer Trommel. Das änderte sich im letzten Jahrhundert mit den elektronischen Instrumenten, denn bei ihnen wird die „akustische Energie“ durch Strom erzeugt. Die Künstler*innen können sich so eine Fülle an Möglichkeiten der Klangerzeugung und -formung ausdenken.

Zahlreiche Pionier*innen der elektronischen Musik, die die ersten Stücke komponierten und auch die dazugehörigen Instrumente entwickelten, waren Frauen. Sie vereinten künstlerische Sensibilität mit Kenntnissen in Wissenschaft und Technik.

In diesem Kapitel werden wir

Pionierinnen der elektronischen Musik

Das Theremin wurde 1928 patentiert und ist eines der ersten elektronischen Instrumente, das noch heute verwendet wird. Die Art der Bewegung, mit der man den Klang steuert, war revolutionär: Man spielt das Instrument, indem man die Hände in der Luft bewegt. Während die eine Hand die Tonhöhe steuert, regelt die andere die Lautstärke eines von Oszillatoren erzeugten Dauertons.

Spiele das virtuelle Theremin direkt in dem Feld unten.

Das Publikum hatte zunächst Vorbehalte, das Theremin als „richtiges“ Musikinstrument anzuerkennen. Doch eine Ausnahmekünstlerin überzeugte viele Menschen.

Clara Rockmore (1911-1998) stammte aus Litauen und war eine klassisch ausgebildete Theremin-Virtuosin. Als Kind galt sie als Wunderkind auf der Geige, musste das Instrument aber als Jugendliche wegen einer Sehnenentzündung aufgeben. In dieser Zeit lernte sie Leon Theremin kennen und begeisterte sich für seine neue Erfindung. Dank ihrer Ausbildung und ihres absoluten Gehörs (der angeborenen Fähigkeit, Töne ohne äußere Anhaltspunkte zu erkennen) konnte sie eine einzigartige Spieltechnik entwickeln. Gemeinsam mit Leon Theremin arbeitete sie an der Verbesserung des Instruments. Bereits 1938 gab sie große öffentliche Konzerte und trat als Solistin mit dem New York Philharmonic Orchestra, dem Philadelphia Orchestra oder dem Toronto Symphony Orchestra auf.

Tonbandgeräte revolutionierten die Musik ab den 1940er Jahren. Jedwedes Geräusch - von einem Instrument, aus der Natur oder von Haushaltsgegenständen - , das auf Tonband aufgenommen wird, kann verlangsamt (wodurch die Tonhöhe gesenkt wird) oder beschleunigt (wodurch die Tonhöhe erhöht wird) werden. Geräusche können auch rückwärts abgespielt oder durch Filter geleitet werden. So entsteht jeweils ein neuer Klang, den es vorher nicht gab. Tonbandaufnahmen können auch geloopt, überlagert oder geschnitten und neu arrangiert werden.

Damit begann eine ausdrucksstarke Manipulation des Klangs selbst, losgelöst von seiner ursprünglichen Quelle.

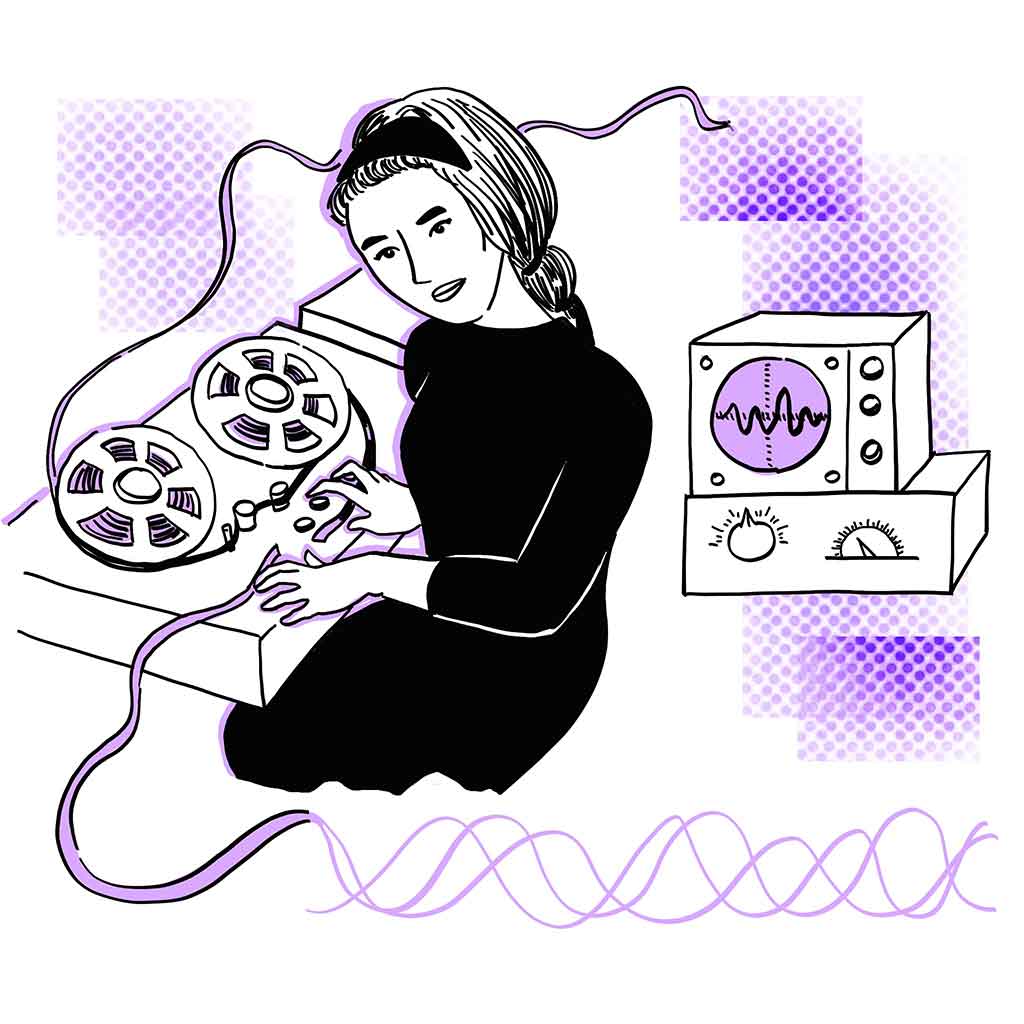

Delia Derbyshire (1937-2011), eine britische Mathematikerin und Komponistin, ist berühmt für ihr elektronisches Arrangement des Titelsongs von Doctor Who aus dem Jahr 1963. Es war eines der ersten rein elektronischen Musikstücke, die im Fernsehen verwendet wurden. Sie arbeitete über zehn Jahre im BBC Radiophonic Workshop, einer Pionierabteilung für Soundeffekte, die Geräusche und Musik für Radio und Fernsehen produzierte. Eines ihrer bekanntesten Werke aus dieser Zeit ist „Inventions for Radio“, eine Reihe von akustischen Collagen mit Menschen, die über Träume, Gott, das Leben nach dem Tod und die Erfahrung des Alters sprechen, immer unterlegt mit einer elektronischen Klanglandschaft. Als Freiberuflerin arbeitete sie mit bedeutenden Persönlichkeiten der britischen Kunstszene zusammen, darunter Yoko Ono oder die Royal Shakespeare Company. Außerdem wirkte sie bei Filmen, Theaterstücken und frühen elektronischen Musikveranstaltungen mit.

Zu Beginn arbeitete Delia Derbyshire mit klangerzeugenden elektronischen Geräten wie Oszillatoren, Wobbelgeneratoren, Generatoren für Weißes Rauschen und Tonbandgeräten. Diese Geräte wurden mit Knöpfen und Schaltern bedient und waren nicht für eine musikalische Anwendungen konzipiert. Daher erforderte die Komposition eines Musikstücks eine lange und sorgfältige Planung. Doch letztlich entstanden so, erzeugt durch synthetische Klänge, neue musikalische Welten, die über den Rundfunk für ein breites Publikum erlebbar wurden.

Daphne Oram (1925-2003) gehörte 1958 zu den Mitbegründer*innen des Radiophonic Workshop der BBC und war eine der ersten britischen Komponistinnen, die elektronische Klänge erzeugte und mit Field Recordings (Feld- bzw. Außenaufnahmen) arbeitete. 1959 richtete sie ihr eigenes elektronisches Musikstudio ein und entwickelte die Oramic Synthesis. Dies ist ein System, das die elektronische Klangerzeugung mit Hilfe mehrerer Streifen aus durchsichtigem 35-mm-Film steuert, auf denen mit einem Pinsel ausdrucksstarke Linien gemalt werden. Diese Streifen werden der Maschine zugeführt, im Anschluss liest ein fotoelektrischer Sensor die Linien. Jeder Streifen steuert dabei einen anderen Parameter der Oramic Synthesis (Tonhöhe, Lautstärke, Hüllkurve usw.).

Die Oramic Synthesis war eine frühe Form des „Sequenzers“, die es ermöglichte, den Moment der expressiven Bewegung vom Moment der Tonerzeugung zu trennen. Daphne Oram verstand die Freiheiten, die sich aus der Möglichkeit ergaben, Musik unabhängig vom Spielen eines Instruments zu produzieren, und formulierte sie folgendermaßen:

„Sobald der Komponist ohne die Einschränkungen der Aufführung komponieren kann, wird seine Palette enorm erweitert. Rhythmen werden zu allem, was der Komponist sich vorstellen kann, ohne dass sie spielbar sein müssen. Klangfarben haben keine Registrierungen, und theoretisch ist jeder Klang, ob musikalisch oder nicht, für ihn [den Komponisten] greifbar.“

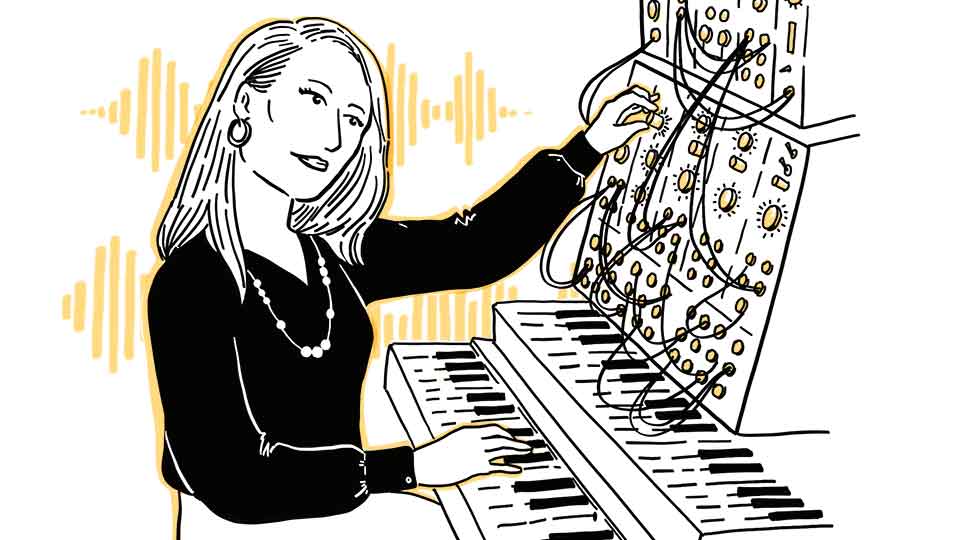

Um diese Freiheiten herum, die die elektronische Musik mit sich brachte, wurden neue Instrumente entwickelt. Als sie die Entwicklungswerkstätten verließen und in die Hände von Musiker*innen gelangten, begann eine regelrechte Revolution. Einige dieser neuen Geräte definierten völlig neue Genres. Ein bemerkenswertes Beispiel ist der Moog, der erste kommerzielle Synthesizer. Wendy Carlos hat an seiner Entwicklung mitgewirkt und war gleichzeitig eine der berühmtesten Interpret*innen .

Wendy Carlos (geboren 1939) ist eine amerikanische Musikerin und Komponistin. Sie studierte Physik und Musik an der Brown University und interessierte sich schon früh für elektronische Musik. Sie arbeitete an der Entwicklung des Moog-Synthesizers mit und schlug unter anderem eine berührungsempfindliche Oberfläche vor, um eine größere musikalische Dynamik zu ermöglichen. Berühmt wurde sie mit „Switched-On Bach“, einem Album mit Bach-Kompositionen, die auf dem Moog gespielt wurden. Das Album erzielte kommerziellen Erfolg und erhielt auch sehr gute Kritiken. 1970 wurde es mit drei Grammys ausgezeichnet. Da der Moog nur eine Note gleichzeitig spielen konnte, mussten mehrere Spuren separat aufgenommen und kombiniert werden, um die Stücke zu erstellen. Wendy Carlos komponierte darüber hinaus die Filmmusik für Stanley Kubricks A Clockwork Orange (1971) und The Shining (1980) sowie für den Disney Science-Fiction-Klassiker Tron (1982). Als offen lebende Transfrau trug sie dazu bei, das öffentliche Bewusstsein für Transgender-Themen zu schärfen.

Künstliche Intelligenz hat eine Revolution in der elektronischen Musik ausgelöst. Sie kann den Künstler*innen heutzutage noch mehr Freiheit geben:

- Sie kann neue Ausdrucksformen ermöglichen.

- Sie bietet neue Mittel, Klangfarben, Genres und musikalische Formen zu erforschen.

- Sie ermöglicht es uns, Klang ganz nach unserer Vorstellungskraft formen zu können, ohne dass wir uns auf die Möglichkeiten des physischen Körpers begrenzen müssen.

In anderen Kapiteln werden wir einige dieser Aspekte genauer untersuchen.

Wie funktioniert die KI?

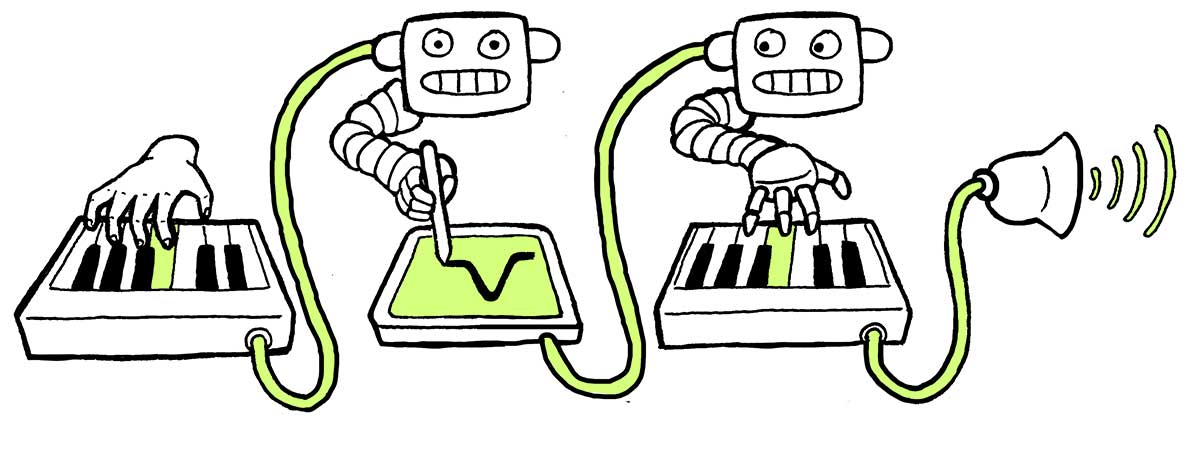

Diese KI wurde mit Hilfe von zwei neuronalen Netzen entwickelt, die zusammenarbeiten: einem Encoder und einem Decoder. Der Encoder wandelt eine Folge von auf dem Klavier gespielten Noten in eine einfache „Form“ um (eine Kurve, die sich entsprechend der Tonhöhe der gespielten Noten nach oben oder unten bewegt), und der Decoder wandelt diese Form wieder in Klaviernoten um.

Die neuronalen Netze wurden mit Hunderten von Klavierstücken verschiedener Stilrichtungen trainiert, die von Klassik bis hin zu modernen Stücken reichen. Beim (automatischen) Training wurde eine Melodie in eine bestimmte Form und diese Form wieder in eine Melodie umgewandelt, bis die Eingabe und die Ausgabe so ähnlich wie möglich waren.

Die obige interaktive Funktion verwendet nur den trainierten Decoder. Er verwendet die von dir gezeichnete Form als Eingabe, um eine Folge von Klaviertönen zu erzeugen, die denjenigen ähnlich sind, auf die er trainiert wurde. Der Decoder kann jede Form dekodieren, auch wenn sie direkt gezeichnet und nicht vom Encoder erzeugt wurde. Dank seines Trainings hat er gelernt, die in der Klaviermusik häufig vorkommenden Muster und Strukturen zu reproduzieren, um neue, originelle Melodien zu erzeugen.

Einige Punkte zum Nachdenken

Die gleichen technologischen Fortschritte, die die Art der Musikproduktion verändert haben, haben auch die Art unseres Musikkonsums verändert: Kopfhörer, 3D-Sound, CDs, tragbare Musikplayer, Musikvideos, Streaming-Dienste, Karaoke, sog. „Musikspiele“, usw.

Inwieweit kann KI Hörer*innen ein noch intensiveres Musikerlebnis bieten und sie noch aktiver involvieren?

Externe Links

- Der exzellente Dokumentarfilm Sisters with Transistors zeigt die Geschichte der Pionierinnen der elektronischen Musik.

- Spiele mit Piano Genie, der Originalversion der KI, die auf dieser Seite verwendet wird.

Referenzen

Illustrationen von Constanza Rojas-Molina, lizensiert unter der Creative-Commons-Lizenz „Namensnennung - Weitergabe unter gleichen Bedingungen 4.0 international“. (CC BY-SA 4.0). Copyright 2023 Constanza Rojas-Molina.

Basierend auf Piano Genie, erstellt von Chris Donahue, Ian Simon und Sander Dieleman als Teil des Google Magenta-Projekts.

Copyright- und Lizenzinformationen sind in unserem GitHub-Repository.

Quellenangaben

- „Sisters With Transistors“. Drehbuch und Regie von Lisa Rovner. Anna Lena Films. 2020.

- Wikipedia-Autoren. „Clara Rockmore.“ In Wikipedia, The Free Encyclopedia. 2022-10-20. Abgerufen am 2022-12-10.

- Warshaw, Dalit (March 2011). „Clara Rockmore: A Legendary Performer of an Enigmatic Instrument.“ The Juilliard Journal. The Juilliard School. 2011-03. Archived on 2016-04-02. Abgerufen am 2022-12-10.

- Dr. David Butler. „Delia Derbyshire.“ In „100 Years of our BBC.“ BBC website. c. 2018-12. Abgerufen am 2022-12-10.

- Steve Marshall. „The Story Of The BBC Radiophonic Workshop.“ Sound on Sound. 2008-04. Abgerufen am 2022-12-01.

- Wikipedia-Autoren. „Wendy Carlos.“ Wikipedia, The Free Encyclopedia. 2022-12-11. Abgerufen am 2022-12-17.

- Wikipedia-Autoren. „Theremin.“ Wikipedia, The Free Encyclopedia. 2022-12-14. Abgerufen am 2022-12-19.

Text is available under the Creative Commons Attribution License . Copyright © 2022 IMAGINARY gGmbH.